Bij veel gemeenten bestaat een datateam uit niet meer dan 2 tot 5 personen. Capaciteit om te ontwikkelen is daarmee beperkt en diepgaande kennisopbouw is beperkt door een veelvoud aan onderwerpen en vraagstukken waar het datateam verantwoordelijk voor is. Gemeenten zoeken daarom naar manieren om samen te werken op het gebied van datagedreven werken, om collectief meer te bereiken.

Grofweg kan met samenwerking voordeel gehaald worden op de volgende gebieden:

- Techniek

- Data-producten

- Specialiseren

- Kennisdeling

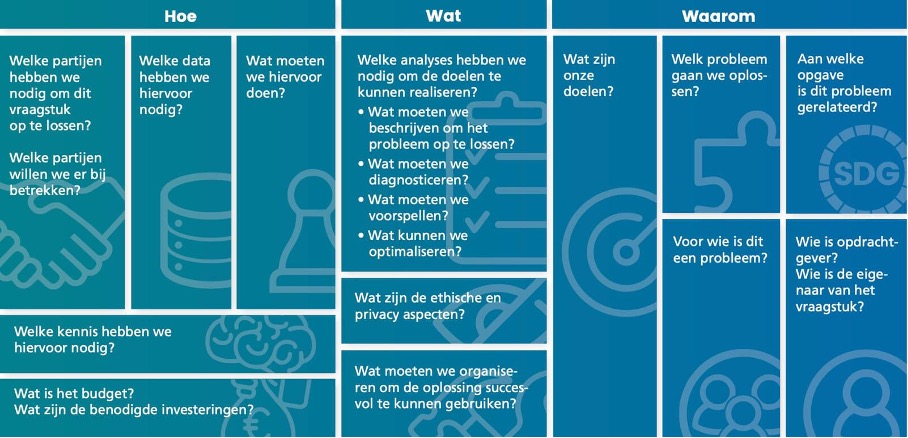

Deze gebieden kennen een zekere overlap en samenhang met elkaar. In mijn visie op samenwerking is het belangrijk vooraf na te denken op welk van deze gebieden het zwaartepunt ligt van de samenwerking. En vooral om dit naar elkaar uit te spreken, om op eenzelfde lijn te komen. Waar zit dan de winst op deze gebieden?

1. Techniek

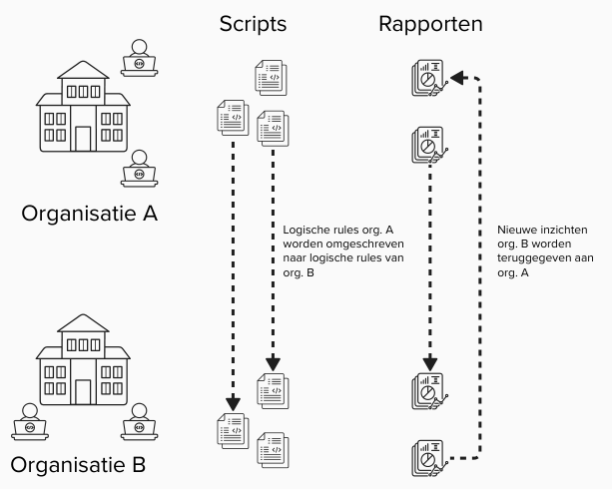

Door samen op te trekken op technisch vlak, kunnen implementatie- en ontwikkelkosten significant gedrukt worden. De oplossing hoeft meer één keer uitgewerkt te worden en kan meervoudig uitgerold worden. Ik versta hieronder een technisch fundament (het dataplatform en aanverwante componenten) dat gelijk is aan elkaar. Dit kan gaan om één gezamenlijk dataplatform of één per gemeente. Hiermee wordt ook een technisch fundament gelegd waarop data-producten en kennisdeling eenvoudiger te realiseren zijn. Voor de gemeente Nissewaard, Voorne aan Zee en Hoeksche Waard hebben we dit in een half jaar weten te realiseren.

2. Data-producten

Het gezamenlijk werken aan data-producten zorgt ervoor dat niet elke gemeente haar eigen oplossingen hoeft te ontwikkelen. Dit helpt de ontwikkelcapaciteit te vergroten en stimuleert ook kennisuitwisseling op vakinhoudelijk gebied (bijvoorbeeld ondermijning, sociaal domein of groenbeheer). Let wel op goede afspraken rondom beheer en doorontwikkeling. Data Fryslân laat heel concreet zien wat dit op regionaal niveau aan meerwaarde kan opleveren.

3. Specialiseren

Voor een kleine tot middelgrote gemeente is het lastig om alle rollen uit een datateam zelfstandig aan te nemen. Door een gezamenlijk datateam te vormen (of functies te delen), kan meer specialisatie geworven worden. Dit zorgt voor diepgaandere kennis en datateams die meer van elkaar kunnen leren. Veelal gebeurt dit onder de vlag van een shared service center of ander bestaand samenwerkingsverband. Een goed voorbeeld hiervan is Datalab GO, waar gemeenten uit Oost Gelderland de krachten bundelen. Uitdaging bij gezamenlijke datateams is om goed contact te houden met de decentrale businessunits.

4. Kennisdeling

Dit is de meest eenvoudige variant van samenwerking. En gebeurt al veel onder de vlag van de VNG via https://kennisnetwerkdata.pleio.nl. Maar het kan ook gebeuren op kleinere schaal zoals via gezamenlijke inspiratiesessies voor datateams of juist de business op regionaal niveau. Een voorbeeld hiervan is de datadag van de Zuid-Hollandse Delta gemeenten. Kennisdeling kan ook plaatsvinden door op bovenstaande gebieden te richten, en vanuit daar kennisdeling te stimuleren.

Elkaar vasthouden en gunnen

Denk bij het verkennen van samenwerkingen goed na over wat je met elkaar wilt bereiken en wees ervan bewust dat het in de beginfase vooral draait om elkaar vasthouden en elkaar wat gunnen. En dan nog een open deur, maar niet minder belangrijk: wees ervan bewust dat het (zeker in de beginfase) gaat om persoonlijke relaties. Uiteraard helpt bestuurlijke borging en betrokkenheid.

Zoek elkaar op en laten we samen meer waarde gaan halen uit data!

Meer weten?

Voor meer informatie kun je contact opnemen met Tim van der Pol via de contactpagina.